Apple continua a investire nella ricerca sull’intelligenza artificiale e ha presentato un nuovo modello progettato per funzionare direttamente sul dispositivo.

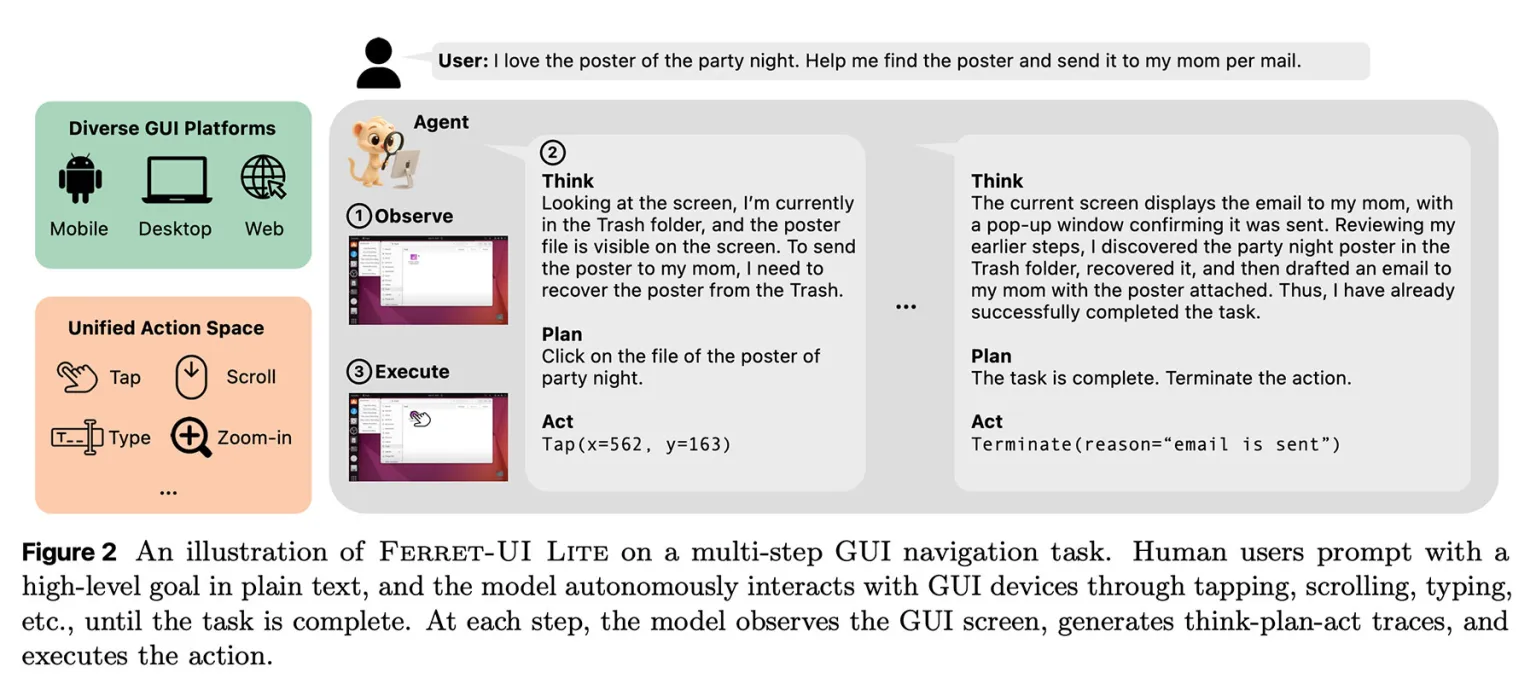

Si chiama Ferret-UI Lite ed è un agente AI capace di interagire con le interfacce delle app per conto dell’utente, pur avendo “solo” 3 miliardi di parametri.

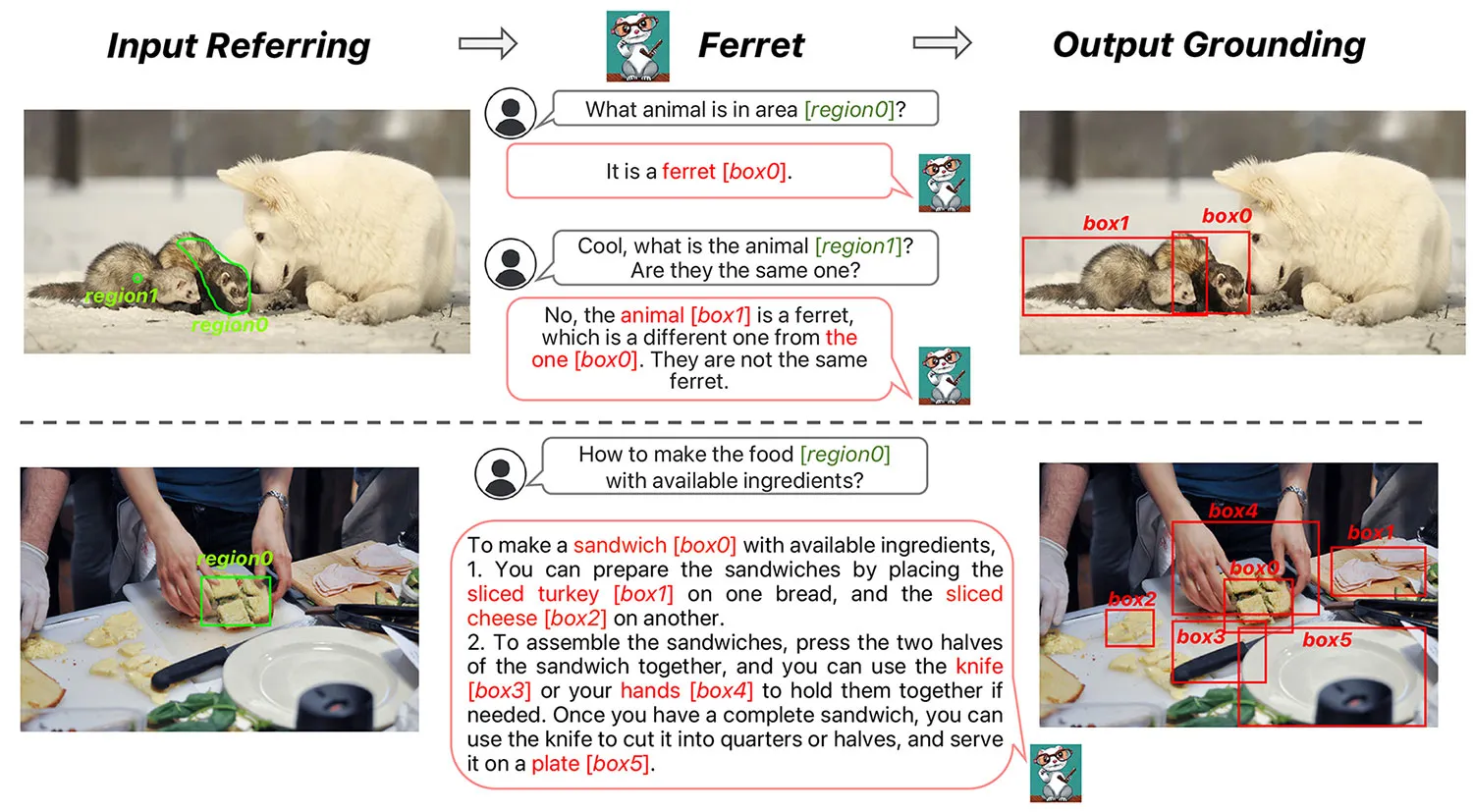

Nel dicembre 2023, un team di nove ricercatori aveva pubblicato uno studio intitolato “FERRET: Refer and Ground Anything Anywhere at Any Granularity”, introducendo un modello multimodale in grado di comprendere riferimenti in linguaggio naturale a parti specifiche di un’immagine.

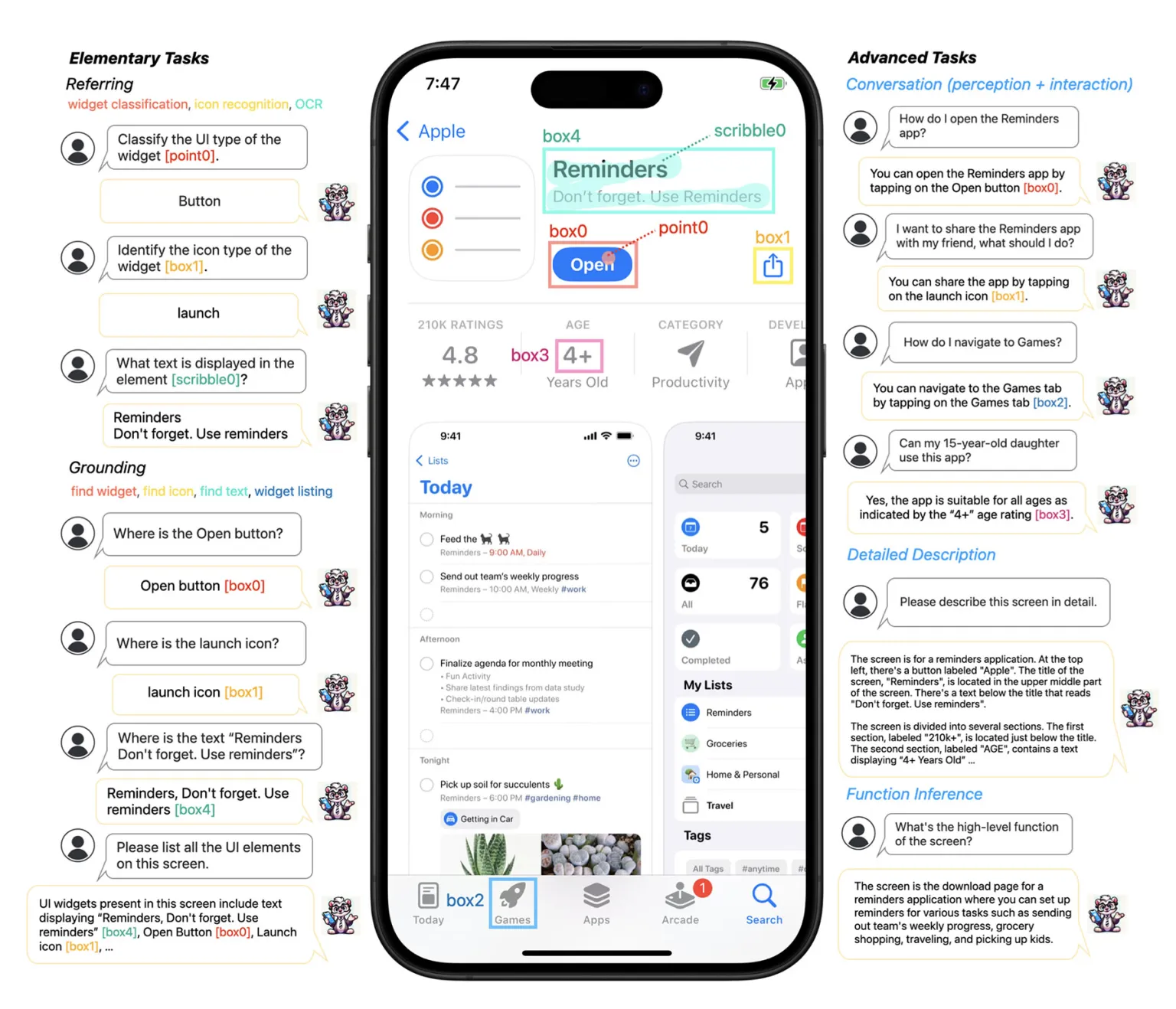

Da allora, Apple ha ampliato la famiglia Ferret con diversi lavori successivi, tra cui Ferretv2, Ferret-UI e Ferret-UI 2. In particolare, le varianti Ferret-UI hanno esteso le capacità del modello originale per affrontare un limite dei modelli multimodali generalisti.

Dal paper originale Ferret-UI:

“Negli ultimi anni i progressi nei modelli linguistici multimodali (MLLM) sono stati notevoli, tuttavia questi modelli generalisti spesso non riescono a comprendere e interagire efficacemente con le schermate delle interfacce utente (UI). In questo lavoro presentiamo Ferret-UI, un nuovo MLLM progettato per migliorare la comprensione delle schermate mobili, dotato di capacità di riferimento, grounding e ragionamento. Poiché le schermate UI presentano generalmente un rapporto d’aspetto più allungato e contengono oggetti di interesse più piccoli (come icone e testi) rispetto alle immagini naturali, integriamo un sistema “any resolution” sopra Ferret per ingrandire i dettagli e sfruttare caratteristiche visive potenziate.”

Pochi giorni fa, Apple ha ulteriormente ampliato la famiglia con lo studio “Ferret-UI Lite: Lessons from Building Small On-Device GUI Agents”.

Se Ferret-UI si basava su un modello da 13 miliardi di parametri focalizzato sulla comprensione di UI mobili a risoluzione fissa, e Ferret-UI 2 aveva esteso il sistema a più piattaforme e a percezione ad alta risoluzione, Ferret-UI Lite rappresenta un approccio radicalmente diverso: un modello molto più leggero, progettato per funzionare direttamente sul dispositivo pur restando competitivo con agenti GUI molto più grandi.

Secondo i ricercatori: “la maggior parte dei metodi esistenti per gli agenti GUI si concentra su grandi modelli foundation”. Questo perché “le forti capacità di ragionamento e pianificazione dei grandi modelli lato server consentono a questi sistemi agentici di ottenere prestazioni impressionanti in diversi compiti di navigazione GUI”.

Il problema è che tali sistemi risultano troppo pesanti e dispendiosi in termini computazionali per essere eseguiti efficacemente on-device. Da qui la decisione di sviluppare Ferret-UI Lite, una variante da 3 miliardi di parametri costruita “con diversi componenti chiave, guidati da intuizioni sull’addestramento di modelli linguistici su piccola scala”.

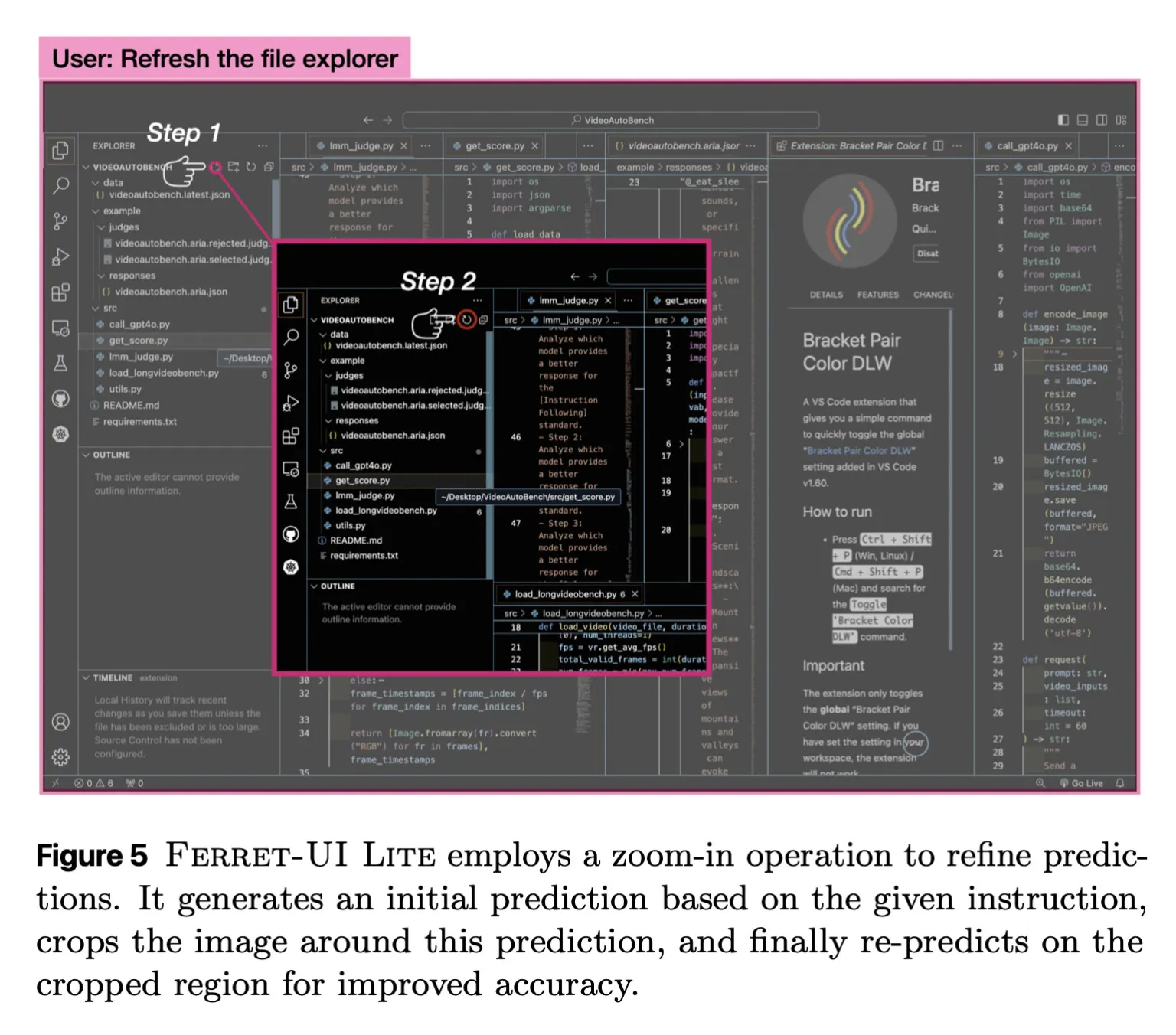

Ferret-UI Lite sfrutta dati di addestramento reali e sintetici provenienti da diversi domini GUI, tecniche di cropping e zoom in tempo di inferenza per comprendere meglio specifiche porzioni dell’interfaccia, oltre a fine-tuning supervisionato e reinforcement learning.

Il risultato è un modello che eguaglia o supera le prestazioni di agenti GUI con un numero di parametri fino a 24 volte superiore.

Particolarmente interessante è la tecnica di cropping e zoom dinamico: il modello effettua una previsione iniziale, ritaglia l’area rilevante e rielabora la previsione sulla porzione ingrandita. In questo modo compensa la capacità limitata di elaborare grandi quantità di token visivi.

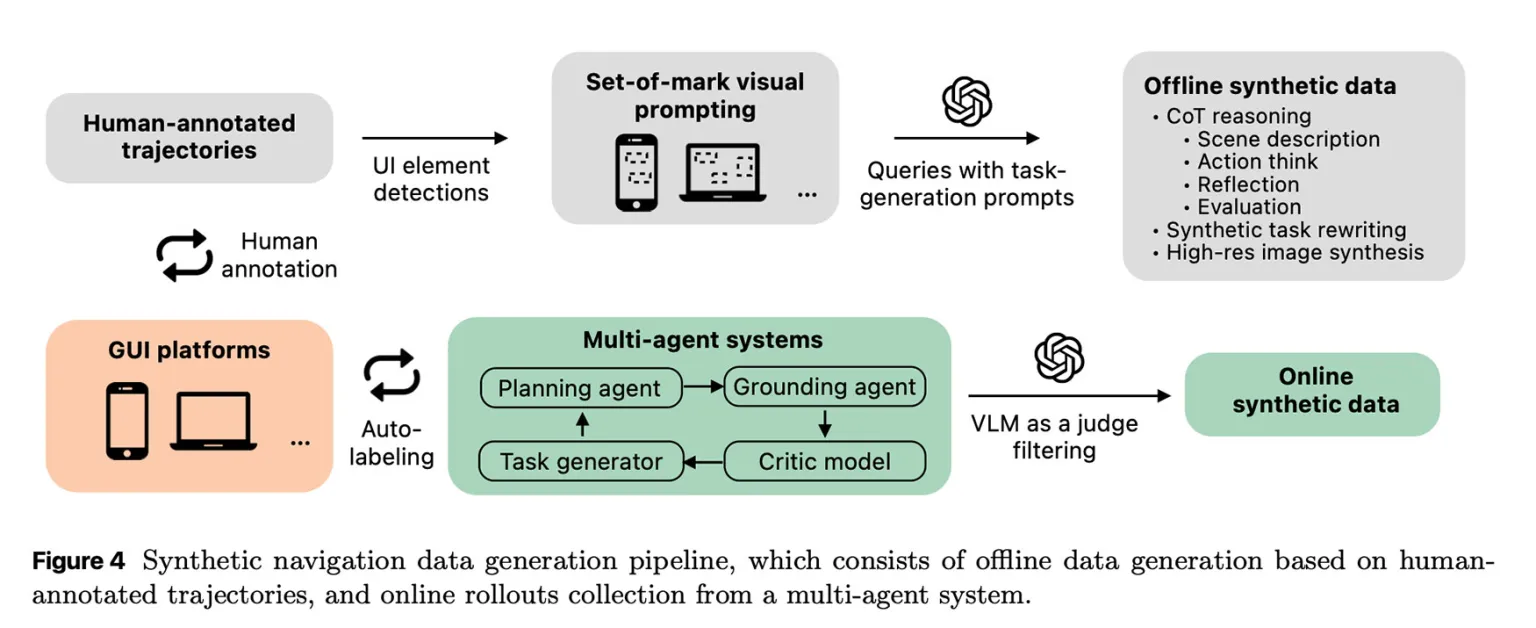

Un altro contributo rilevante riguarda la generazione autonoma dei dati di training. I ricercatori hanno sviluppato un sistema multi-agente che interagisce direttamente con piattaforme GUI reali per produrre esempi sintetici su larga scala. Un generatore di task propone obiettivi di difficoltà crescente, un agente di pianificazione li suddivide in passaggi, un agente di grounding li esegue sullo schermo e un modello critico valuta i risultati.

Questo pipeline consente di catturare la complessità delle interazioni reali, inclusi errori, stati inattesi e strategie di recupero, aspetti difficili da riprodurre utilizzando esclusivamente dati annotati manualmente.

Curiosamente, mentre Ferret-UI e Ferret-UI 2 erano stati valutati anche su screenshot di iPhone e altre interfacce Apple, Ferret-UI Lite è stato addestrato e testato su ambienti Android, web e desktop, utilizzando benchmark come AndroidWorld e OSWorld. I ricercatori non spiegano esplicitamente questa scelta, ma è probabile che dipenda dalla disponibilità di testbed riproducibili e su larga scala per agenti GUI.

Nei risultati, Ferret-UI Lite mostra prestazioni solide nei compiti a breve orizzonte e nelle interazioni di basso livello, mentre risulta meno efficace in scenari complessi multi-step, un compromesso atteso considerando i vincoli di un modello compatto on-device.

Il vantaggio è quello di avere un agente locale che rispetta la privacy, non richiede l’invio dei dati al cloud e può interagire autonomamente con le app in base alle richieste dell’utente.

- Filtra:

- Tutte

- Apple

- Minimo Storico

- Alimentari e cura della casa

- Bellezza

- Cancelleria e prodotti per ufficio

- Casa e cucina

- Elettronica

- Giardino e giardinaggio

- Giochi e giocattoli

- Grandi elettrodomestici

- Illuminazione

- Informatica

- Moda

- Prodotti per animali domestici

- Salute e cura della persona

- Sport e tempo libero

- Videogiochi

Leggi o Aggiungi Commenti