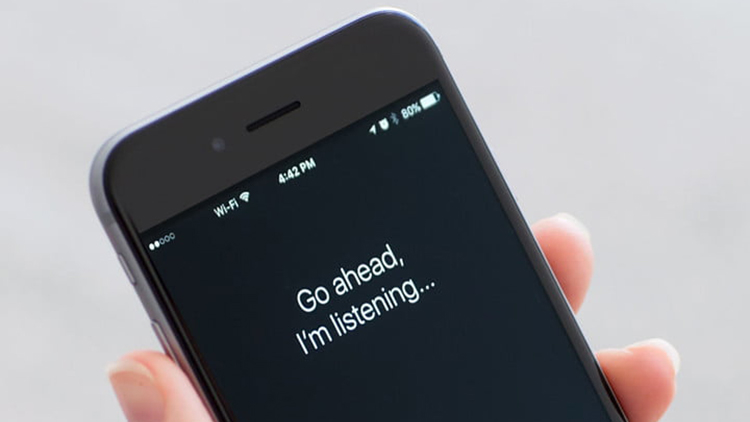

Gli assistenti vocali diventano sempre più popolari ed evoluti eppure basta un semplice stratagemma per utilizzarli a scopi malevoli per estorcere informazioni, effettuare chiamate, aprire siti web e perfino trasferire denaro.

Secondo gruppi di ricerca intervistati dal New York Times, sarebbe possibile inserire in tracce audio e brani musicali dei comandi audio malevoli, non udibili all’orecchio umano. Tali comandi potrebbero essere inseriti anche nel rumore bianco o nelle note vocali ed essere interpretati da Siri, Alexa e Google Assistant effettuando le relative azioni.

Se gli smartphone e gli smart speaker venissero presi d’assalto per ottenere informazioni, l’utente non si accorgerebbe di nulla visto che i suoni vengono trasmessi a frequenze non udibili dall’orecchio umano ma percepibili dai microfoni di questi dispositivi. Negli ecosistemi sempre più connessi si potrebbe arrivare perfino a trasferire denaro o effettuare acquisti online mentre ascoltiamo una canzone.

In una dimostrazione, i ricercatori sono stati in grado di nascondere il comando “Ok Google, apri il sito evil.com” all’interno di una registrazione vocale, senza che l’orecchio percepisse la minima cosa. L’esperimento è stato ripetuto nascondendo lo stesso comando anche all’interno del Requiem di Giuseppe Verdi.

Ad un malintenzionato basterebbe caricare un brano su YouTube o altre piattaforme per entrare nel vostro telefono. Al momento gli utenti Apple sono quelli che corrono meno rischi perchè Siri si attiva soltanto se riconosce la voce del proprietario e richiede il codice di sblocco per poter svolgere alcune operazioni con dati sensibili.

I commenti sono chiusi per questo articolo.

3 Commenti